- This topic has 1개 답변, 1명 참여, and was last updated 2 months, 1 week 전에 by

simmon. This post has been viewed 204 times

-

-

안녕하세요. simmon입니다.

요즘 ai 관련 부분에 관심이 많아서, 해당 자료 및 사용 부분에 대한 기초적인 부분을 작성합니다.

다양한 ai 언어 모델별 지원 및 구성 부분을 확인 할 수 있는 기술환경으로 ollama를 시도해 볼 수 있습니다.

해당 환경은 llama3, gemma, gemma2, phi, mistral, 등등 다양한 언어 모델을 간단히 설치해 시험 할 수 있습니다.

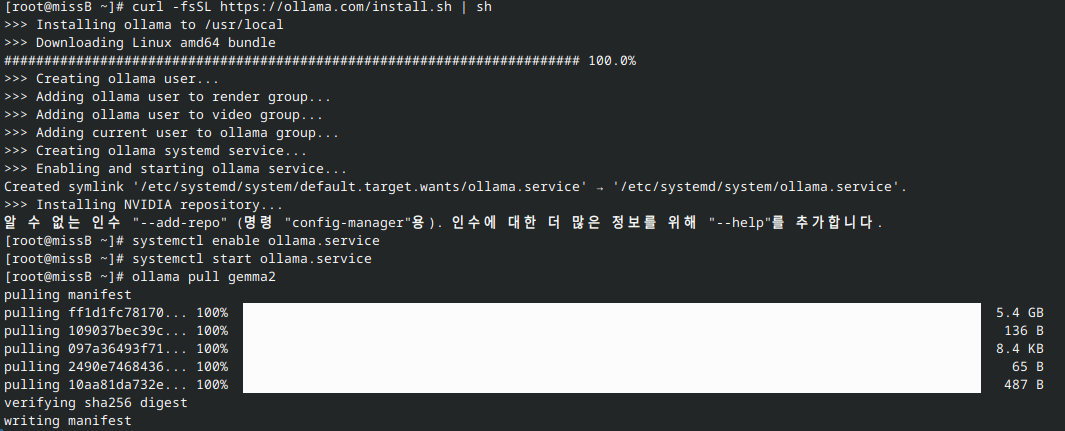

1. 우선 설치 환경을 위한 기술환경에서 ollama를 다음과 같이 설치합니다. gemma2 용량은 5.4GB 용량을 차지합니다.

# curl -fsSL https://ollama.com/install.sh | sh

2.언어 모델 시험을 위해 google 모델인 gemma의 최신 배포판인 gemma2를 설치해 봅니다.

# systemctl enable ollama.service

# systemtl start ollama.service

# ollama pull gemma2

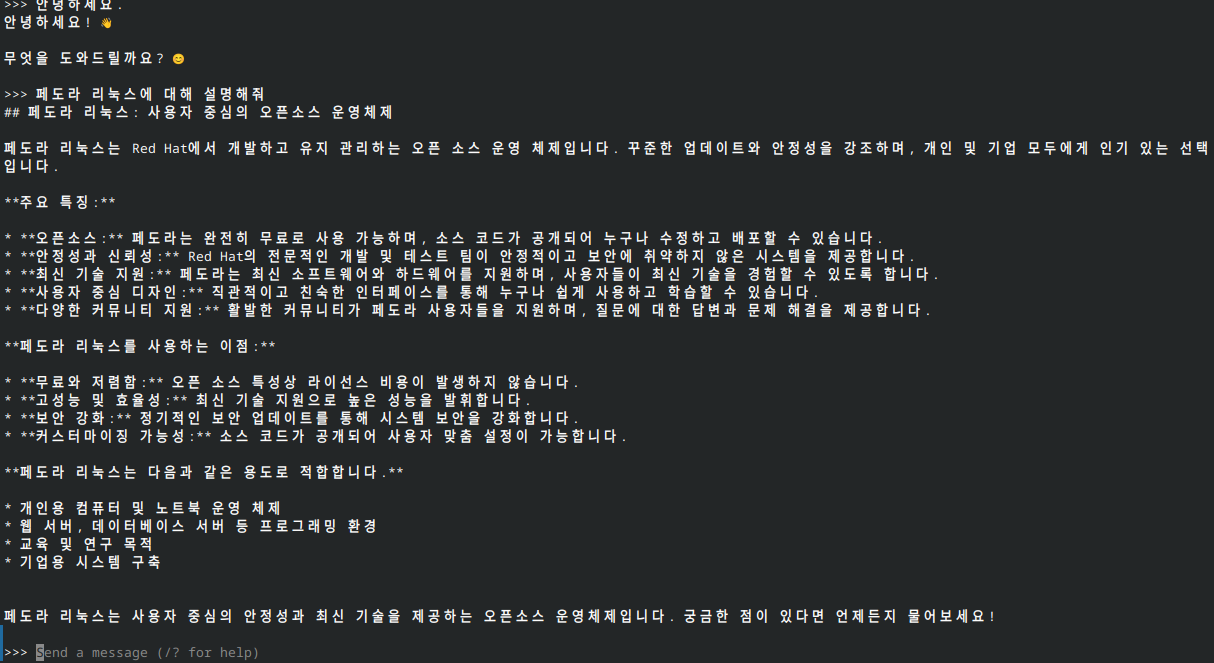

3. 사용자 계정에서 설치한 언어 모델인 gemma2를 시험합니다.

가. 사용자 계정으로 전환해서 ollama를 실행합니다.

$ ollama run gemma2

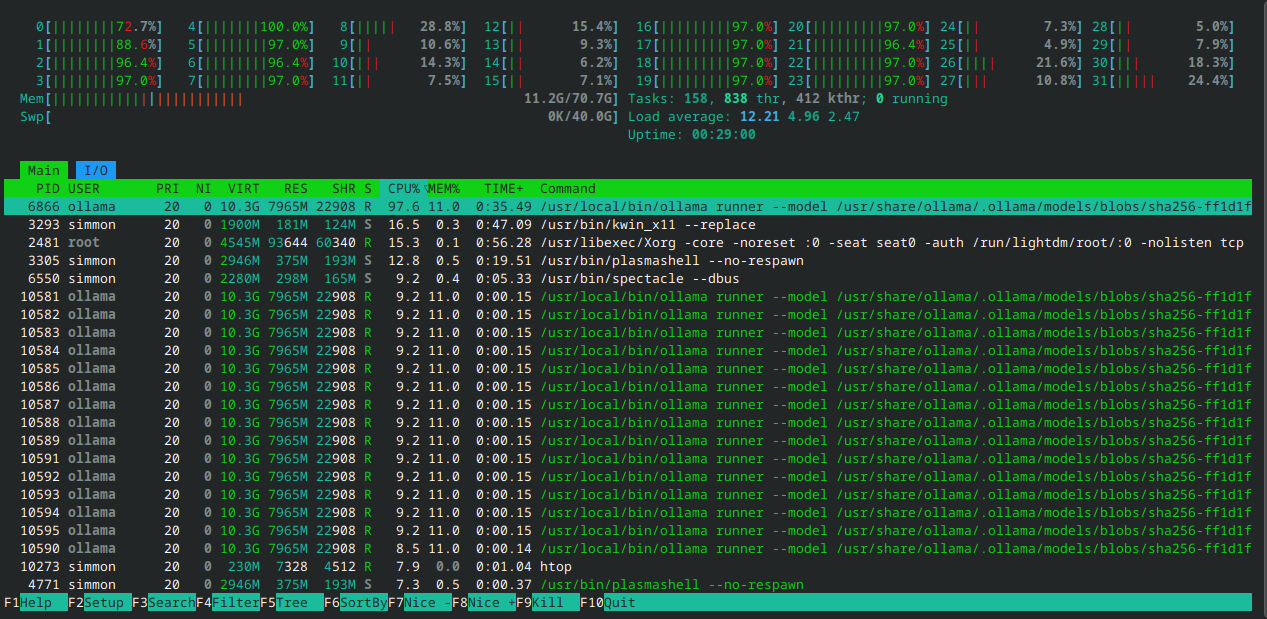

나. cpu만을 사용해도 잘 동작하나, 코어수가 많아야 합니다. 코어가 적으면 응답 시간 또한 오래 발생합니다.

다. 실시간 동작 특성을 통해 텍스트 형태의 답변을 구 할 수 있습니다.

4. 웹 서비스 등의 시험 및 요구사항

가. ollama 언어모델은 자기 학습을 통해 고유 언어 모델을 만들 수 있으며, 이런 과정은 언어 모델 제작을 위한

과정을 거쳐야 합니다. 이미 만들어진 언어 모델에서 학습 기능은 없습니다.

나. cpu 및 gpu 적용을 통해 다양한 언어 모델을 시험 할 수 있습니다.

다. 웹 및 파이썬 등을 이용해 서버와 연동해 서비스 할 수 있습니다. 기초적인 학습 시험에 적합합니다.

라. 다양한 언어 모델을 시험은 대략 10GB 이하의 언어모델의 경우 cpu를 통해 시험 가능하나, 그 이상 크기를

갖는 모델의 경우 GPU 및 다중 GPU 설치 환경이 필요 할 수 있습니다.

5. 기타

ollama는 정말 빠른 설치와 적용 과정을 통해 다양한 언어 모델을 시험해 볼 수 있는 사용자 친화적인 환경을

구성하고, gui가 없는 터미널 환경에서 잘 동작합니다. 이는 서버 환경에 더 최적화 지원을 통해 ai 언어 모델을

시험 할 수 있는 부분이라 생각합니다.

한번 사용해보고, 나름의 ai 동작 특성을 보는 것도 좋은 시도인 것 같습니다. 멋진 하루 보내세요

written by simmon

https://accounts.fedoraproject.org/user/simmon/

- 답변은 로그인 후 가능합니다.